Anthropic thêm cơ chế 'mơ mộng' cho tác nhân AI, đẩy cuộc đua bộ nhớ dài hạn sang giai đoạn mới

Điểm nổi bật

- Ra mắt lúc 15:54 ngày 7/5 (GMT+7): bài VnExpress xác nhận tính năng Dreaming của Anthropic xuất hiện trong đúng cửa sổ slot cuối ngày.

- Rút ngắn thời gian xây tác nhân tới 10 lần: Claude Managed Agents được Anthropic mô tả là hạ tầng có thể giúp nhà phát triển triển khai agent nhanh gấp 10 lần so với cách tự dựng thông thường.

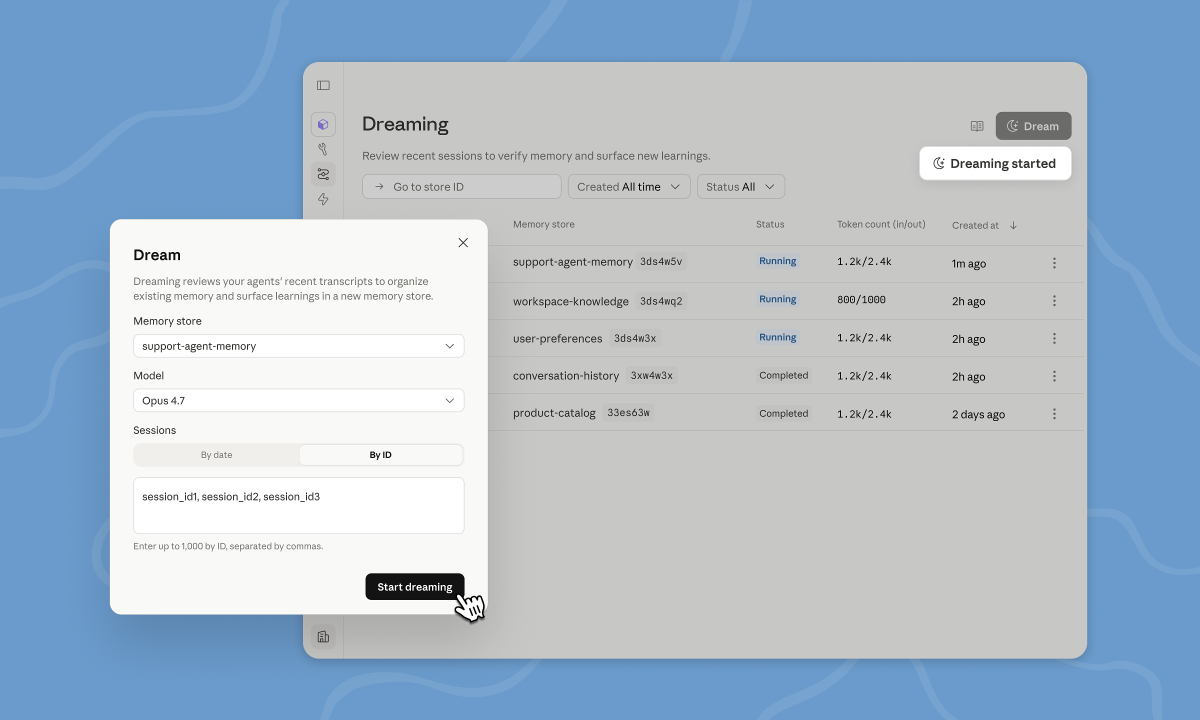

- Dreaming quét lại nhiều phiên làm việc: hệ thống định kỳ xem lại sự kiện gần nhất, chọn lọc thông tin cần giữ và tái cấu trúc bộ nhớ để dùng cho nhiệm vụ sau.

- Hỗ trợ nhiều tác nhân cùng chia sẻ trí nhớ: bộ nhớ không chỉ gói trong một phiên chat mà có thể được phân tích trên nhiều agent trong cùng workflow.

- Anthropic gắn tính năng mới với tham vọng dài hạn: Jack Clark từng nêu xác suất 60% AI tiên tiến sẽ góp phần đào tạo thế hệ kế tiếp trước cuối năm 2028, cho thấy Dreaming không chỉ là tính năng nhỏ mà là bước chuẩn bị cho agent tự vận hành lâu hơn.

Biểu đồ

Tóm tắt

Anthropic đang thử một hướng nâng cấp đáng chú ý cho tác nhân AI: thay vì chỉ mở rộng context window hoặc tăng giới hạn dùng, hãng thêm cơ chế “mơ mộng” để agent tự xem lại lịch sử làm việc, lọc điều quan trọng và lưu vào bộ nhớ có thể tái sử dụng. Nếu coi agent là một nhân viên số, thì Dreaming là bước chuyển từ “trả lời tốt trong một phiên” sang “học từ nhiều phiên và làm việc có tính liên tục”.

Điểm chiến lược nằm ở chỗ cuộc cạnh tranh agent đang dịch chuyển khỏi lớp mô hình lõi sang lớp orchestration và memory. Trong môi trường doanh nghiệp, lỗi lặp, mất ngữ cảnh và quên quyết định cũ thường mới là điểm nghẽn thực sự. Dreaming vì thế đáng chú ý không phải vì nó nghe hấp dẫn về mặt marketing, mà vì nó tấn công đúng vấn đề vận hành của agent production.

Chi tiết

Tính năng Dreaming mà Anthropic trình diễn tại sự kiện Code with Claude ngày 6/5 cho thấy hãng đang thử giải một bài toán mà hầu như mọi đội ngũ xây agent đều gặp: hệ thống càng chạy lâu, càng nhiều bước và càng nhiều tác nhân phối hợp, nguy cơ quên ngữ cảnh quan trọng hoặc lặp lại sai lầm cũ càng tăng. Claude Managed Agents vốn được định vị là một nền tảng cloud giúp nhà phát triển dựng agent nhanh hơn, lo phần thực thi và hạ tầng bên dưới. Nay với Dreaming, Anthropic cố gắng thêm vào đó một lớp “hồi tưởng có cấu trúc”.

Theo mô tả trong bài, Dreaming hoạt động bằng cách rà lại danh sách sự kiện gần nhất, xác định những gì có giá trị cho nhiệm vụ tương lai rồi lưu vào bộ nhớ. Đây là khác biệt quan trọng so với cách nhiều chatbot hiện xử lý hội thoại dài bằng nén ngữ cảnh định kỳ. Nén ngữ cảnh thường chỉ nhằm giữ phiên chat không vượt giới hạn đầu vào; còn Dreaming hướng tới việc quyết định thứ gì đáng được lưu như tri thức vận hành. Nói cách khác, nó biến memory từ cơ chế tiết kiệm token thành cơ chế học việc.

Điểm đáng chú ý thứ hai là phạm vi áp dụng trên nhiều agent. Khi một workflow cần nhiều tác nhân phụ trách các phần việc khác nhau, bài toán không còn là một model nhớ gì, mà là cả hệ thống chia sẻ tri thức ra sao. Nếu làm tốt, Dreaming có thể giúp một agent hiểu vì sao agent khác từng thất bại, bước nào đã được chốt, dữ liệu nào cần ưu tiên và ràng buộc nào không được phá vỡ. Đây là nền tảng quan trọng nếu thị trường thực sự đi theo hướng agent đa bước, đa vai trò trong các tác vụ kéo dài hàng giờ hoặc hàng ngày.

Về mặt kinh doanh, tính năng này cũng cho thấy Anthropic muốn khóa chặt vị thế ở phân khúc lập trình viên và doanh nghiệp. Khi agent được dùng cho coding, back-office hoặc hỗ trợ nghiệp vụ, giá trị không nằm ở việc trả lời một prompt thật hay, mà ở việc duy trì chất lượng qua thời gian. Một agent quên quyết định cũ, làm lại bước đã hoàn tất hay lặp lỗi từng mắc sẽ tiêu hao niềm tin của người dùng rất nhanh. Dreaming là lời hứa rằng Anthropic có thể đưa agent từ dạng demo sang dạng cộng sự số ổn định hơn.

Tuy vậy, cũng cần giữ khoảng cách với hype. Bài viết cho biết Dreaming mới ở giai đoạn nghiên cứu thử nghiệm và chỉ mở cho nhóm nhà phát triển đăng ký trước. Điều đó có nghĩa khả năng thực chiến, chi phí vận hành, mức tăng hiệu quả thật và rủi ro memory drift vẫn chưa được kiểm chứng rộng rãi. Một bộ nhớ sai hoặc tích lũy thiên lệch còn nguy hiểm hơn việc không nhớ gì, vì nó có thể khiến agent tự tin lặp lại kết luận cũ mà không bị người dùng nhận ra ngay.

Ở tầng chiến lược, động thái này báo hiệu thị trường agent đang trưởng thành. Giai đoạn đầu là đua model và context. Giai đoạn kế là đua công cụ và connector. Còn giai đoạn hiện tại đang mở ra cuộc đua về memory, autonomy và governance: agent nhớ gì, quên gì, ai duyệt thay đổi và khi nào được phép hành động. Dreaming của Anthropic vì thế đáng theo dõi như một tín hiệu nền tảng, không chỉ là một tính năng mới lạ.